MITがALS患者のコミュニケーションを支援するウェアラブルセンサーを発表

2020年10月、MIT MediaラボのConformable Decodersグループで研究されているALS患者のコミュニケーションを支援するウェアラブルセンサーがNature Biomedical Engineeringに掲載されたことを発表した。

ALS(筋萎縮性側索硬化症)は手足・のど・舌の筋肉や呼吸に必要な筋肉が、徐々にやせて力がなくなっていく病気である。筋肉そのもののではなく、筋肉を動かすための脳や脊髄の神経が障害をうけるため、筋肉を動かすという指令が届かず、病状末期には全身の運動麻痺に至る。日本ALS協会によると、日本においても約9,000人の難病医療券を申請している患者がおり、米国においても2015年で16,583人のALS患者がいることがCDCによって明らかにされている。

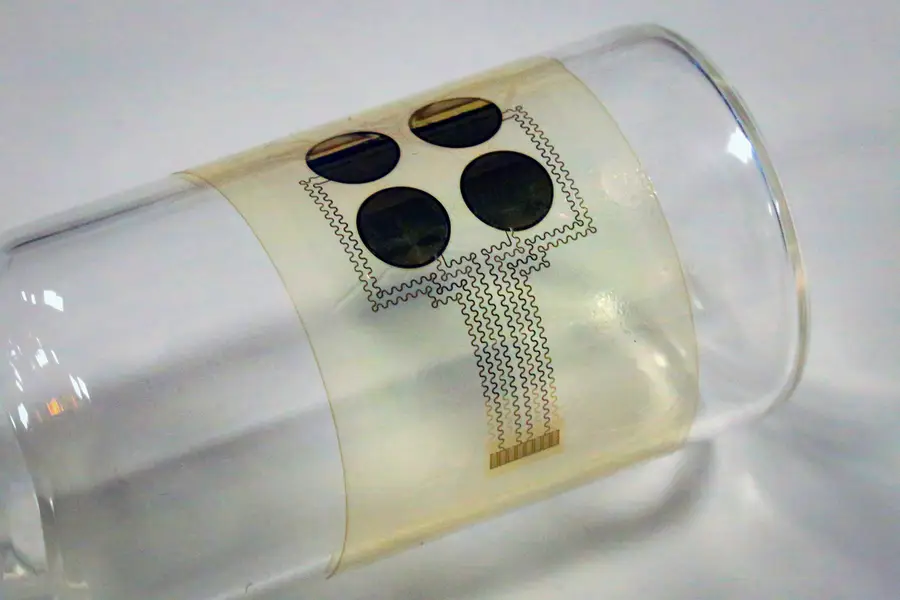

MITが開発したALS患者のコミュニケーション支援をするウェアラブルデバイス

このデバイスは患者の顔に取り付けて、けいれんや笑顔などの小さな動きを測定できる、伸縮性のある皮膚のようなデバイスとなっている。このデバイスを使用することで、患者は「愛しています」や「お腹が空いた」などのさまざまな感情を、デバイスを通して測定・解釈され、相手に伝えることができるという。

2018年に亡くなったホーキング博士も進行の遅い形態のALSに苦しんでおり、画面上の文字の行と列にカーソルを移動するための、頬の動きを検出できる赤外線センサーを使用してコミュニケーションを取っていた。他の患者の例では、顔面筋を制御する神経の電気的活動を測定する同様のデバイスを使用しているものがある。しかし、こうした従来の機器はかさばる機器が必要であり、日常で使うには課題も多かった。

今回のMITの研究は、そうしたかさばる機器を不要とし、皮膚のようなセンサーでALS患者のコミュニケーションを支援することができる。

研究チームが製作したデバイスは、薄いシリコンフィルムに埋め込まれた4つの圧電センサーで構成されている。窒化アルミニウム製のセンサーは、皮膚の機械的変形を検出し、簡単に測定できる電圧に変換するという構造となっている。

これらのコンポーネントはすべて大量生産が容易であるため、今回の発表で、研究チームはデバイスのコストは約10ドルにすることができると見積もっている。

研究チームはまた、皮膚変形の測定値を使用し、笑顔、口を開ける、唇をすぼめる、といった動作を区別するための機械学習アルゴリズムをトレーニングしている。このアルゴリズムを2人のALS患者でテストした結果として、こうした異なる顔の動きを判定するのに約75%の精度を達成することができたという(なお、健康な被験者における顔の動きの正解率は87%)。

これらの検出可能な顔の動きに基づき、動きのさまざまな組み合わせに対応するフレーズや単語のライブラリを作成できると研究チームは述べている。

CONTACT

お問い合わせ・ご相談はこちら